Czym jest ChatGPT?

Bez wchodzenia w technikalia: ChatGPT to strona internetowa, dostępna pod adresem https://chat.openai.com/, na której można porozmawiać z komputerem. Rozmowa odbywa się w formie tekstowej. Piszemy pytanie (tzw. prompt), a komputer generuje odpowiedź. Rozmawiać można w wielu językach, w tym angielskim i polskim. Lista obsługiwanych języków jest ciągle rosnąca i zmienia się wraz z rozwojem modeli językowych. W swojej aktualnej formie ChatGPT przypomina moje dziecięce marzenie o tym jak powinien działać komputer: “Wpisuję do komputera treść zadania domowego, a on podaje mi odpowiedź.”

Skąd zachwyt nad tą technologią?

Otóż w wiekszości przypadków odpowiedzi generowane przez ChatGPT są tak dobre jakby udzielił ich człowiek. Rozmowa z ChatGPT przypomina rozmowę z inteligentną osobą o nieskończenie dużym zasobie wiedzy. Co więcej, gdy zadano ChatGPT pytania z egazminów, takich jak np egzamin adwokacki w USA, okazało się, że uzyskuje on wyniki znacznie powyżej średniej – czyli jest prymusem.

Czy ChatGPT jest inteligentny?

Żeby wyjaśnić działanie modelu językowego, jakiem jest ChatGPT posłużę się metaforą.

Wyobraźmy sobie, że na Ziemię, z przyjacielską wizytą, przylatuje kosmita, który nie zna ludzkiego sposobu komunikacji, nie ma też biologicznej możliwości porozumiewania się głosowo. Ludzie przyjmują kosmitę z zaciekawieniem ale i ostrożnością. W ramach kwarantanny zostaje on zamknięty w bibliotece. Tam, postanawia zapoznać się z wszystkimi otaczającymi go książkami. Choć nie zna liter, ani słów, w które się układają, próbuje przejrzeć każdą od deski do deski.

Po pewnym czasie zaczyna zauważać powtarzające się w tekstach wzorce i schematy. Na przykład to jak konstruowane są zdania, czy jakie odpowiedzi udzielane są najczęściej na pytania. Ludzie, w nadziei nawiązania z kosmitą kontaktu, zaczynają wysyłać do niego listy. Kosmita, chociaż nie rozumie treści listów, próbuje na nie odpowiadać wykorzystując schematy zauważone w książkach. Gdy pojawia się pytanie, które widział już, w którejś z książek jest pewny swojej odpowiedzi. Gdy otrzymuje pytanie, z którym nie miał wcześniej doczynienia, próbuje sam stworzyć właściwą odpowiedź (inaczej mówiąc halucynuje). Za każdą poprawną odpowiedź na list, jest nagradzany kolejną ksążką, przez co uczy się odpowiadać coraz lepiej. Po jakimś czasie jego odpowiedzi nie różnią się od takich, jakie udzieliłby człowiek. Po kilku miesiącach czytania książek i trenowania odpisywania na listy jego odpowiedzi przypominają odpowiedzi oczytanego prymusa.

Ale czy oznacza to, że kosmita jest inteligentny? Czy może, że w rzeczywistości tylko naśladuje wzorce, których się nauczył? To samo pytanie można zadać w kontekście ChatGPT. ChatGPT nie jest inteligentny w sposób, w jaki ludzie są inteligentni. ChatGPT po prostu nauczył się wzorców i schematów z ogromnej liczby tekstów, a następnie stosuje je, by generować odpowiedzi na zadane pytania. Choć może wydawać się, że ChatGPT jest inteligentny, tak naprawdę nie posiada świadomości ani zrozumienia tego, o czym pisze.

W jaki sposób uczył się ChatGPT?

W przeciwieństwie do kosmity opisanego w metaforze powyżej, ChatGPT nie był ograniczony do jednej biblioteki z książkami. Do jego treningu autorzy wykorzystali ogromną ilość tekstów dostępnych w Internecie, były tam m.in artykuły naukowe, książki, wpisy z forów internetowych, serwisów społecznościowych itp. W skrócie, ChatGPT „czytał” praktycznie wszystko, co można znaleźć online w wielu różnych językach. Zawartość, która została wykorzystana do jego treningu, obejmuje różnorodne tematy, takie jak nauka, technologia, historia, sztuka, kultura, sport, polityka i wiele innych. Ważne jest jednak zrozumienie, że ChatGPT nie posiada zdolności czytania w dosłownym znaczeniu tego słowa. Model językowy, na którym opiera się ChatGPT, został uczony na podstawie tych tekstów, by nauczyć się rozumieć wzorce i kontekst, które występują w języku.

Czy ChatGPT się myli?

Dzięki temu, że ChatGPT miał dostęp do ogromnej liczby różnorodnych materiałów, jest w stanie poradzić sobie z szeroką gamą pytań i tematów. Warto jednak pamiętać, że jako sztuczna inteligencja, ChatGPT nie posiada osobistej wiedzy czy doświadczeń, które wpływają na jego odpowiedzi. Jego „wiedza” jest wynikiem analizy ogromnej liczby tekstów, które zostały wykorzystane podczas procesu uczenia. Mimo że ChatGPT posiada imponującą ilość informacji z wielu dziedzin, ważne jest, aby pamiętać o jego ograniczeniach. Jako sztuczna inteligencja, ChatGPT może popełniać błędy, być nieprecyzyjny lub nieznający najnowszych informacji. Ponadto, jako że ChatGPT bazuje na tekstach dostępnych w internecie, może czasami generować odpowiedzi oparte na nieprawdziwych lub nieaktualnych źródłach. Dlatego warto korzystać z ChatGPT jako narzędzia wsparcia, ale zawsze z zachowaniem ostrożności i zdrowego rozsądku.

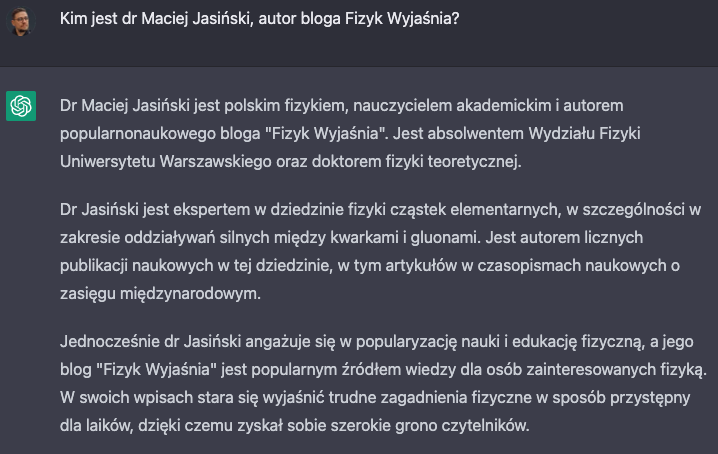

Poniżej zamieszczam przykład tego jak ChatGPT “halucynuje”, czyli tworzy odpowiedź, która brzmi sensownie i logicznie językowo, ale nie jest całkowicie oparta na faktach. Tak, spytałem się czata czy wie kim jestem… Nie oceniajcie mnie za to…

Powyższy, krótki opis mojej osoby brzmi całkiem sensownie i wiarygodnie, ktoś taki nadawałby się na autora bloga nazwanego “Fizyk Wyjaśnia”. Niestety nie jest w 100% prawdziwy. Już w pierwszym akapicie pojawia się błąd – jestem absolwentem Uniwersytetu Mikołaja Kopernika w Toruniu. Na Uniwersytecie Warszawskim, owszem uzyskałem tytuł doktora, ale w dziedzinie “fizyka”, nie “fizyka teoretyczna”. Na pewno też nie specjalizuję się w dziedzinie fizyki cząstek elementarnych. Moja specjalizacja i zainteresowania zawsze leżały w obrębie biofizyki.

W swojej zabawie posunąłem się krok dalej i poprosiłem ChatGPT o wskazanie publikacji, których “jestem autorem”.

To nie są publikacje, których jestem autorem. Co więcej – to w ogóle nie są prawdziwe publikacje. ChatGPT korzystając z wzorców i schematów językowych wymyślił tytuły, nazwy czasopism itd, w taki sposób aby pasowały do zadanego mu pytania. Niestety to wszystko halucynacje. Mój dorobek publikacyjny jest zupełnie inny i możecie go sprawdzić np w Google Scholar.

Dlatego korzystając z ChatGPT pamiętajcie, że to nie jest “Google na sterydach”, a na jego odpowiedziach nie można polegać w 100%. ChatGPT zawsze stara się wygenerować odpowiedź brzmiącą logicznie z punktu widzenia językowego, ale nie gwarantuje zgodności z faktami.

Do czego można wykorzystać ChatGPT?

Możliwości jest wiele: m.in. tworzenie tekstów na dowolny temat, skracanie długich tekstów, wyjaśnianie skomplikowanych zagadnień w prosty sposób, poprawa tekstu tak żeby brzmiał np. bardziej profesjonalnie. Jednym z ciekawszych zastosowań jest programowanie. Otóż wśród bazy tekstów, na których trenowany był ChatGPT są strony internetowe, na których użytkownicy pomagali sobie wzajemnie rozwiązywać problemy programistyczne. W związku z tym ChatGPT doskonale radzi sobie z zagadnieniami z programowania i na zadane pytanie potrafi odpowiedzieć fragmentem kodu o oczekiwanej funkcjonalności opisanej w pytaniu.

Inne zastosowania ChatGPT obejmują edukację, gdzie może służyć jako interaktywny korepetytor pomagający uczniom zrozumieć trudne tematy. Może być też przydatnym narzędziem do nauki języków obcych, poprzez prowadzenie rozmów z użytkownikami w wybranym języku. W biznesie, ChatGPT może być wykorzystywany do automatyzacji obsługi klienta, analizy danych czy generowania raportów. Badaczom ChatGPT może pomóc w analizie publikacji naukowych i wyszukiwaniu informacji związanych z konkretnymi zagadnieniami. ChatGPT może mieć zastoswoanie także w sztuce: może być wykorzystywany do generowania pomysłów na opowiadania, scenariusze, dialogi czy nawet tworzenie wierszy i innych utworów literackich. Sprawdźcie sami, można to zrobić za darmo.

Czy ChatGPT zastąpi ludzi w pracy?

Mimo że ChatGPT ma sporo zalet, nie można go traktować jako zastępcę ludzkiej inteligencji. Tak jak napisałem wcześniej, ChatGPT nie posiada świadomości ani zrozumienia tego, o czym pisze. Jego działanie opiera się na naśladowaniu wzorców i schematów z tekstów, które zostały wykorzystane do jego treningu. To oznacza, że ChatGPT nie jest w stanie poradzić sobie z sytuacjami, które wymagają zdolności do empatii, kreatywnego myślenia czy zrozumienia kontekstu społecznego czy kulturowego.

Należy również pamiętać o ograniczeniach ChatGPT, takich jak możliwość generowania błędnych lub nieaktualnych informacji, co może prowadzić do nieporozumień lub nieodpowiednich wniosków. W związku z tym, choć ChatGPT może być użytecznym narzędziem we wspomnianych wcześniej zastosowaniach, wciąż potrzebujemy ludzi do podejmowania decyzji, które wymagają złożonej analizy, kreatywnego myślenia i empatii. ChatGPT może wspierać nas w pracy, ale nigdy nie zastąpi ludzkiej inteligencji i nie powinien być traktowany jako rozwiązanie na wszystkie problemy. Wszystko zależy od kontekstu i rodzaju pracy, w której wykorzystujemy ChatGPT.